dados

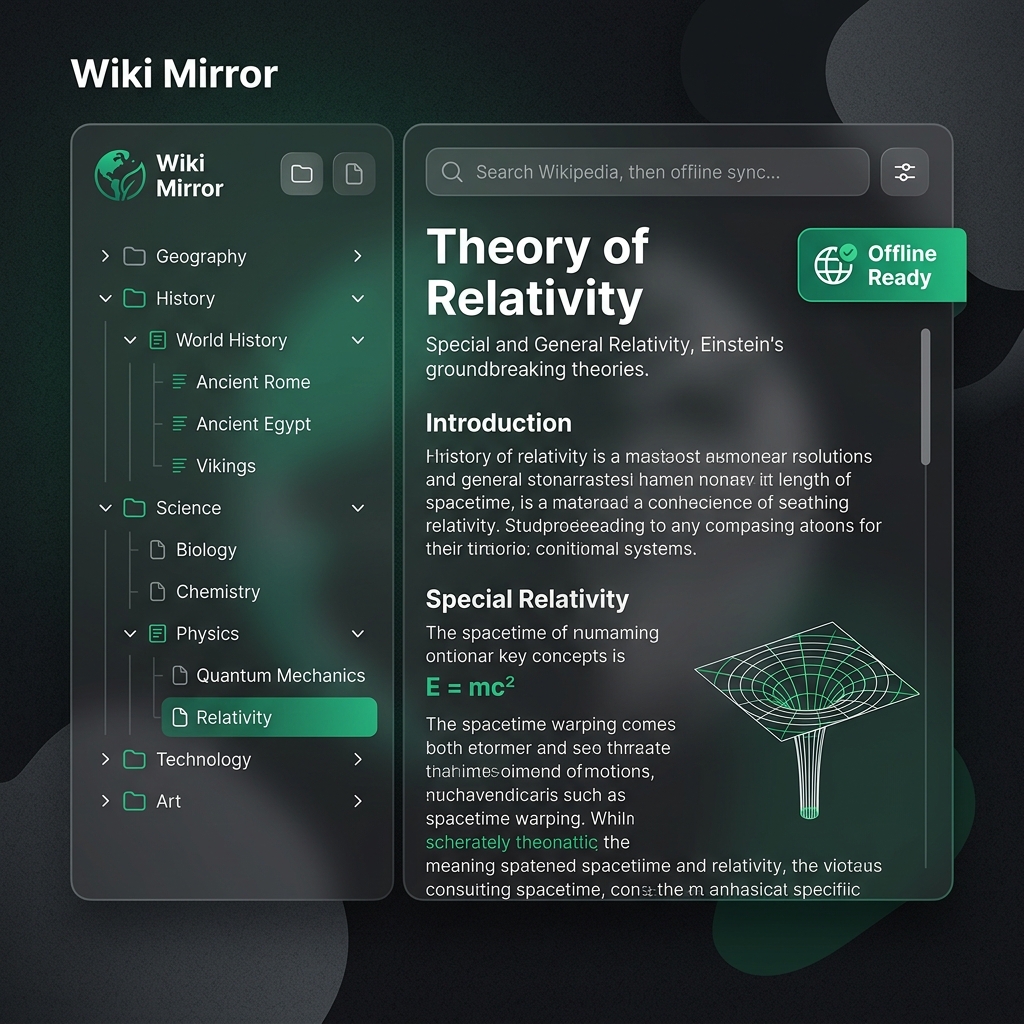

Wiki Mirror Scraper

+12.000 páginas de documentação disponíveis offline, com busca integrada.

o problema

Documentação crítica dependia de conexão estável.

Em ambientes de produção sem internet ou com instabilidade de rede, acessar wikis de referência parava o fluxo de trabalho. A pergunta não era "quando vou precisar" — era "quando a internet vai cair de novo".

Copiar páginas manualmente era inviável na escala necessária. Soluções prontas ou não cobriam os wikis específicos, ou não tinham busca integrada que funcionasse sem servidor.

a solução

Um espelho navegável que roda completamente offline.

Desenvolvi um crawler em Python que captura sistematicamente as páginas do wiki-alvo — conteúdo, estrutura de navegação, links internos — e as organiza em um espelho local navegável.

A interface estática gerada inclui busca por palavra-chave que funciona 100% no client, sem servidor, sem índice remoto. O resultado é um site estático que abre em qualquer navegador, sem dependência de nada externo.

O crawler é configurável por URL-alvo e profundidade de rastreamento. Executado uma vez, o espelho fica disponível indefinidamente. Para atualizar, basta rodar novamente.

resultado

Documentação completa, em qualquer condição.

+12k

páginas indexadas

<1s

retorno da busca

0

interrupções por rede

Com mais de 12.000 páginas indexadas e busca retornando em menos de 1 segundo, o fluxo de trabalho em ambientes sem internet ficou sem interrupção. Zero dependência de conexão em produção.

Precisa de algo parecido?

Automações de dados, crawlers e ferramentas offline. Me conta o que trava o seu fluxo.